2 min pour lire

LLaMa: le nouveau modèle de Meta qui rivalise avec ChatGPT

LLaMa est un modèle de langage artificiel de Meta qui rivalise avec ChatGPT d’OpenAI. Il est plus performant, plus petit et plus rapide.

Salut les amis,

Aujourd’hui, je vais vous parler d’un nouveau modèle de langage artificiel qui fait beaucoup parler de lui dans le monde de l’IA : LLaMa. Non, il ne s’agit pas d’un animal poilu et cracheur, mais d’un acronyme pour Large Language Model Meta AI. Il s’agit d’un modèle développé par Meta (ex-Facebook) pour aider les chercheurs à faire avancer leurs travaux dans le domaine du langage naturel.

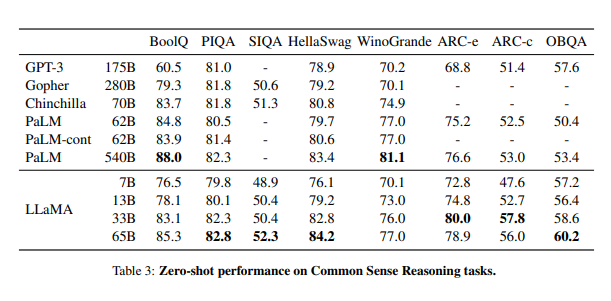

LLaMa est un modèle auto-régressif basé sur l’architecture des transformeurs et qui a été entraîné sur un large corpus de textes provenant du web. Il existe en quatre tailles différentes : 7B, 13B, 33B et 65B de paramètres. Pour comparaison, ChatGPT, le modèle sur lequel se base la célèbre IA conversationnelle d’OpenAI, a été entraîné avec 175B de paramètres.

Mais alors, qu’est-ce que LLaMa a de plus que ChatGPT ? Eh bien, selon Meta, LLaMa est plus performant que ChatGPT sur la plupart des tâches liées au langage naturel, comme la compréhension de texte, la génération de texte ou encore la traduction automatique. De plus, LLaMa est plus petit et plus rapide que ChatGPT, ce qui le rend plus facile à utiliser et à déployer.

Meta a décidé de rendre LLaMa accessible au public en tant qu’outil de recherche ouvert. Cela signifie que n’importe qui peut télécharger les modèles pré-entraînés et les utiliser pour ses propres expériences ou applications. Par exemple, on peut imaginer utiliser LLaMa pour créer des chatbots intelligents, des assistants vocaux personnalisés ou encore des générateurs automatiques d’articles.

Si vous êtes intéressés par LLaMa et que vous voulez en savoir plus ou l’essayer par vous-même, je vous invite à consulter le site officiel du projet : LLaMa. Vous y trouverez toutes les informations techniques sur le modèle ainsi que des tutoriels pour l’utiliser avec différents frameworks comme PyTorch ou Hugging Face.

Si vous êtes intéressé par LLaMa et que vous voulez le tester par vous-même, vous pouvez remplir ce formulaire Google pour accéder aux checkpoints et au tokenizer du modèle. Vous trouverez aussi sur GitHub le code source pour charger le modèle.

Voilà, j’espère que cet article vous a plu et qu’il vous a donné envie d’en savoir plus sur LLaMa et ses applications potentielles. N’hésitez pas à me laisser vos commentaires.

A bientôt !